Qui n’a pas rêvé d’avoir un Mac (Mac Book, iMac, Mac Mini) qui dépote VRAIMENT graphiquement sans pour autant investir des milliers d’euros dans un Mac Pro « sur-mesure » ? Avec notamment l’arrivée du BlackMagic (695€) mi-2018 puis du BlackMagic Pro (1.359€) quelques mois plus tard (fin 2018), c’est devenu possible simplement mais c’est réservé aux possesseurs des Macs récents disposants de ports Thunderbolt 3. Sauf qu’en creusant un peu, il y a moyen de faire mieux et moins cher ! Comment ? Pour quels résultats ? C’est ce qu’on va tenter de voir dans ce retour d’expérience personnel d’octobre 2019.

Un peu d’histoire

L’histoire du eGPU (pour external GPU, ou Processeur Graphique externe) débute fin 2011, date à laquelle Apple évoque dans un document à destination des développeurs une « extension PCI » rendue possible par l’arrivée de la bande passante offerte par la toute nouvelle technologie ThunderBolt, inventée par Intel et apparue en premier sur les MacBook Pro commercialisés en février 2011 qui étaient munis d’un port ThunderBolt 1 (10Gbps, soit 1,25 Go/s, soit une promesse d’un avenir radieux en matière d’échange de données, que ce soit au niveau disque évidemment, mais également vidéo).

Pour autant, malgré la première apparition publique en avril 2012 d’un eGPU au format PCI logé dans un boitier externe raccordé à un Mac via un port ThunderBolt, on était encore loin d’imaginer les évolutions qu’Intel allait apporter à sa technologie, avec la version 2 (20 Gpbs) arrivée en octobre 2013 sur MacBook Pro Retina (2 ports), suivie en 2016 par la version 3 (40 Gbps), toujours sur MacBook Pro (4 ports), et qui rendit beaucoup de monde perplexe (moi le premier) : avec quels périphériques externes allait-on pouvoir exploiter ce boulevard cette nouvelle autoroute ?

La révolution Thunderbolt

De mon côté, c’est en 2016 que j’ai choisi d’upgrader mon « vieil » iMac 24″ Core 2 duo (modèle early 2008) qui commençait vraiment à s’essouffler sous Lightroom. Préférant partir sur du Refurb Apple (matériel reconditionné à neuf, garantie par Apple et qu’on peut toucher à 13-15% moins cher) et n’ayant pas entendu que du bien des derniers modèles sortis en 2015 (surchauffe notamment, ce qui a pour conséquence de faire tourner les ventilos un peu trop bruyamment), je me décidais à partir sur un modèle iMac 27″ – Late 2013 (i7 4ème génération – 24 Go de RAM – Disque Fusion (avec 128 Go de SSD intégré) de 3 To), le tout équipé de … « seulement » 2 ports ThunderBolt 1 (ou TB 1).

Jusque là, partir sur du TB 1 était plutôt cohérent, même si les périphériques TB 2 commençaient à arriver sur le marché (mais chers), disques durs SSD intégrés dans des boitiers dédiés en tête. Pour ma part, je me « contentais » d’un boitier Akitio Neutrino Thunder D3 (1 port USB 3 + 1 port TB 1) intégrant 2 x SSD Samsung 840 EVO de 500Go en RAID 1 afin d’y mettre ma partition utilisateur (pour accélérer l’accès à mes données (cache Lightroom, Dropbox, OneDrive, VMs, etc.) et sécuriser ma configuration. Avec des débits « disque » tout à fait satisfaisants (300Mo/s en écriture et 700Mo/s en lecture en APFS) le goulet d’étranglement que constituaient encore les disques à plateau était de l’histoire ancienne, et tout ce petit monde fonctionne encore aujourd’hui pour le mieux : rien à redire, le ThunderBolt 1 fait le job.

Exploiter le GPU

Le sujet des performances « disque » réglé, je dois avouer que depuis 3 ans je dispose d’une machine qui fonctionne globalement bien, dont les perfs se maintiennent dans le temps malgré les différentes mises à jour d’OS (Sierra, High Sierra, Mojave et désormais Catalina (beta 3). Le seul point qui s’est « logiquement » dégradé avec le temps, c’est les performances d’Adobe Lightroom Classic, et ce pour plusieurs raisons :

- Mon utilisation personnelle:

- Depuis 2016, la taille des fichiers RAW que j’utilise, est passée à 20, 24 puis 26 Mo, ce qui implique plus de travail de dérawtisation pour le logiciel

- J’utilise davantage des « plug-ins » externes, tels que Silver Efex Pro 2 (ce qui implique la génération d’une image TIFF pouvant monter à plus de 140Mo)

- Adobe lui-même:

- De nouvelles fonctionnalités « gourmandes » en ressources sont venues enrichir le panel de fonctionnalités du logiciel

- L’éditeur a connu quelques problèmes de performance, qu’il n’a résolu que récemment. Comment ? Et bien, notamment en exploitant la puissance du GPU … Vous me voyez venir ? 😉

De même, les autres logiciels de post-traitements photo que je suis sont également parfois un peu à la peine sur certaines fonctionnalités. Afin de fluidifier le flux de travail, des performances de traitement supérieures seraient donc parfois appréciées. Pour cela, deux possibilités : acheter une machine plus puissante ou tenter d’exploiter davantage la puissance du GPU.

Pérenniser sa config

En effet, force est de constater que depuis plusieurs années déjà le GPU est devenu de plus en plus puissant, et il eut été vraiment dommage que les applications graphiques gourmandes en vidéo (jeux, montage vidéo, modélisation 3D, CAO, etc.) se passent de cette puissance brute qui leur tend les bras. Pour cela une application doit s’appuyer sur les fonctions graphiques offertes par les API DirectX (Microsoft), OpenGL OpenCL (standards ouvert incluant en autre Apple, nVidia, AMD, IBM) ou Metal (Apple); le gain est alors immédiat.

De plus, sur un PC « monté maison » si la carte graphique n’est pas assez performante il suffit de la changer par une plus récente. Par contre, le Mac Pro mis à part, les machines d’Apple sont tout sauf évolutives et donc, à moins de disposer d’une machine récente (MacBook Pro 2018/2019, iMac 2019, iMac Pro 2017), il faut bien convenir que la carte graphique est au mieux une carte de moyenne gamme correcte pour afficher des images sur un écran 4K ou 5K, voire moins. Mon iMac Late-2013, par exemple, dispose d’une carte graphique nVidia GeForce GTX 780M qui me permet d’afficher confortablement en 2560×1440 sur l’écran 27″ principal ainsi que sur un écran graphique 27″ externe. Même si elle n’est pas vraiment faite pour jouer (le monde Apple n’est pas vraiment le domaine de prédilection des joueurs), elle est cohérente avec la machine et je n’ai jamais eu à m’en plaindre pour mon utilisation; et surtout elle a permis à Lightroom de reprendre quelques couleurs depuis le support du GPU par ce dernier. Mais pourquoi se limiter alors au seul GPU interne pour rajouter de la puissance brute aux applications gourmandes en calcul ? C’est là que le Thunderbolt et le GPU se rencontrent pour donner naissance au eGPU. Le Thunderbolt semble bien être la technologie qui va permettre d’augmenter la longévité d’une machine (et notamment d’un Mac).

Hors ThunderBolt 3, point de salut ?

Oui mais, car il y a un « mais », Apple ne supporte les eGPU que s’ils sont connectés en ThunderBolt 3. Tout du moins officiellement. Car techniquement, ce n’est pas le cas, et ça c’est vraiment LA bonne nouvelle !

En effet, quel que soit le sujet novateur, sur internet il y a toujours une bande de passionnés qui font tomber les barrières. Et dans le cas du eGPU, il y a carrément une communauté que j’ai découverte très récemment et qui m’a apporté toutes les réponses aux questions que je me posais, et même des solutions pour faire fonctionner mon eGPU avec ma config.

Car, comme vous l’avez peut-être compris, je suis dans le cas le plus compliqué avec mon iMac 27″ late-2013 :

- Je n’ai que deux ports ThunderBolt, et surtout ils sont en ThunderBolt 1

- Je tourne sous MacOS Catalina (10.15.1 Beta 3), mais le problème est le même sous Mojave avec un eGPU à base de carte graphique nVidia .

Bref, sur le papier, si je me fie à Apple, c’est impossible car :

- Sans modification, l’OS ne reconnait pas le moindre eGPU connecté sur un port TB 1 ou TB 2

- Apple étant fâché avec nVidia, depuis Mojave ils ont enlevé les APIs nécessaires aux drivers des cartes graphiques nVidia pour gérer les fonctions d’accélération graphique. En d’autres termes, il faut à tout prix choisir une carte graphique AMD si on n’est pas sous High Sierra (première version de MacOS à supporter un eGPU).

Le site journaldulapin.com (non, ce n’est pas une blague ! :p ) m’a permis de « démystifier » l’eGPU sous MacOS, et sur eGPU.io j’ai trouvé le patch qu’il me fallait (purge-wrangler.sh) pour débrider le ThunderBolt et approfondir vraiment le sujet.

Alors, quelle solution ?

En fait, j’ai tout d’abord commencé à m’intéresser de loin au sujet, Lightroom étant capable d’utiliser (timidement) le GPU pour améliorer les performances de quelques fonctions depuis sa version 7.1 (fin 2017). Les débuts du eGPU étant un peu laborieux, apportant même parfois plus de problèmes que d’améliorations dans certains cas, et les fonctions bénéficiant de l’accélération étant peu nombreuses, l’intérêt était limité; bref, il faut bien le dire, les premiers retours d’expérience de mise en oeuvre d’eGPU n’ont pas été transcendants, comme en témoigne cet article d’août 2016.

C’est vraiment avec la sortie du Black Magic d’Apple mi 2018 que j’ai commencé à me renseigner. Mais les avis étaient plutôt peu élogieux, les applications pouvant en profiter étant encore peu nombreuses et le coût de la solution semblant surdimensionné compte tenu de la carte graphique proposée et du fait qu’elle ne puisse pas être changée. Rebelote avec le Black Magic Pro 6 (sorti 6 mois plus tard), pour les mêmes raisons même si la carte graphique qu’il embarque (Radeon RX Vega 56) est plus performante que celle du Black Magic (Radeon Pro 580).

Pour ma part, quitte à investir, j’avais décidé que je partirais sur une solution évolutive, dès lors que le marché serait plus mature. Il y avait déjà des offres alternatives mais il n’y avait pas urgence en ce qui me concerne. La veille technologique était donc de mise. Et un an après, force est de constaté que le développement de l’offre du marché a bien progressé, avec plus d’une vingtaine de boitiers TB3. Mon choix s’est porté très récemment sur :

- Le boitier GFX Breakaway Box 650 de chez Sonnet, qui fonctionne en TB 3

- La carte graphique AMD Radeon VII de chez Gigabyte

Autant le choix du boitier a été relativement simple (compatibilité Apple, puissance de la l’alimentation au regard de la carte graphique), autant j’ai longtemps hésité à partir sur la Radeon VII, 1ère carte gravée en 7nm et qui annonce (sur la papier tout du moins) des performances qui décoiffent.

Concrètement, ça donne quoi ?

Bien sûr, la 1ère chose que j’ai regardé, c’est l’apport au niveau de Lightroom, mais également sur les autres logiciels de post-traitements que je suis de près. J’y reviendrai un peu plus loin, mais la question qui m’importait également c’était de savoir dans quelle mesure la connexion TB1 limitait par rapport à une connexion TB3. Je me suis donc plié aux « traditionnels » benchmarks que sont GeekBench, Unigine Valley et Unigine Heaven et j’ai ensuite comparé les résultats à ceux que j’ai obtenus en connectant l’eGPU directement sur le port TB 3 de mon MacBook Pro 15″ (mid-2018).

Avant cela, précisons tout de même que dans la configuration actuelle de mon iMac n’est pas idéale, car je suis obligé de connecter l’écran externe sur le Display Port du boitier Atikio Thunder 3 RAID Station (connecté via un adaptateur TB3 -> TB 1/2 à l’iMac), au lieu de le rattacher au Display Port de la carte Radeon VII (sinon ce dernier reste noir, c’est un « problème » connu, qui sera peut-être résolu à l’avenir), ce qui bride davantage les performances. Voyons quand même ce que ça donne.

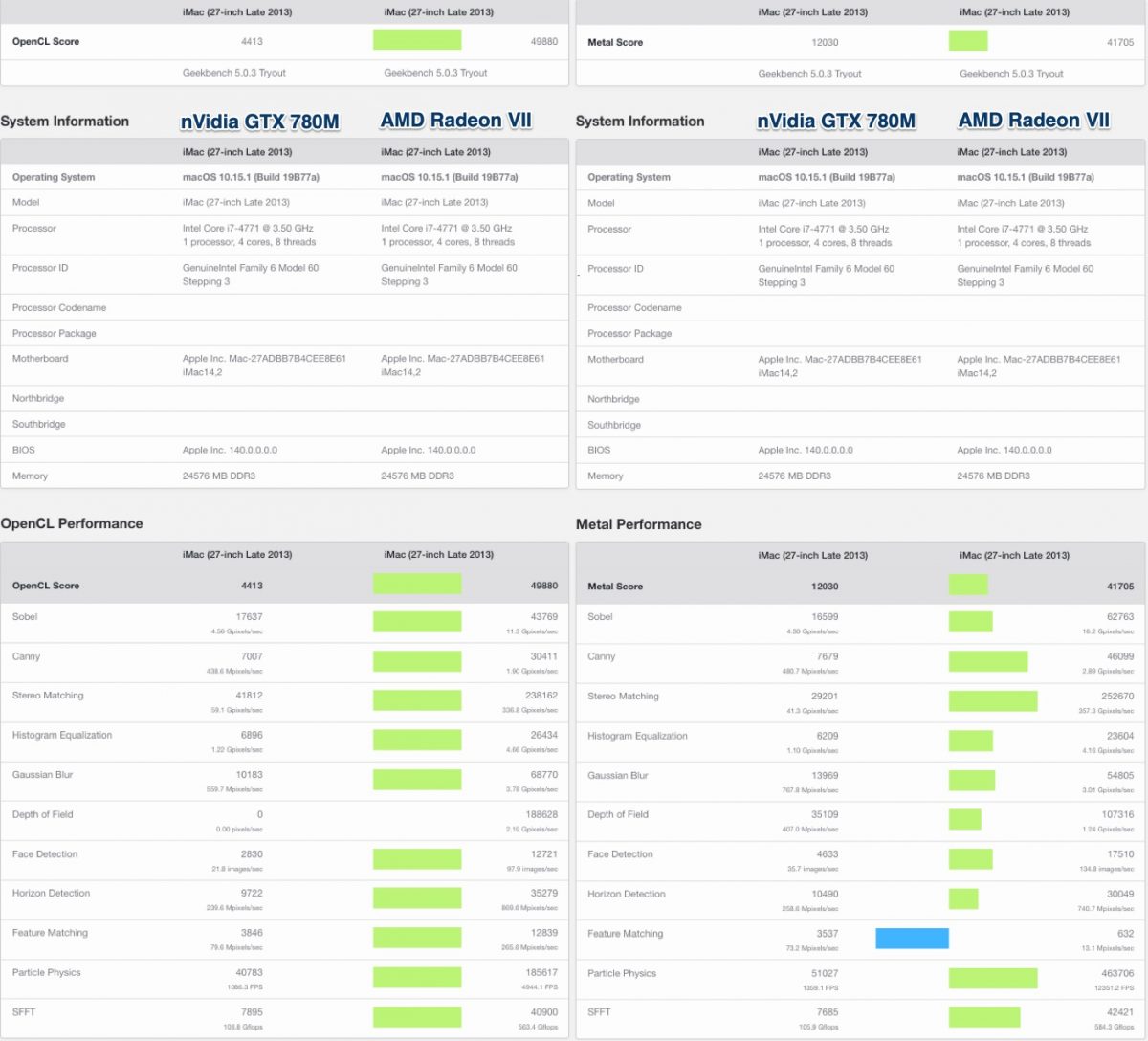

GeekBench 5.03

Le test a été réalisé avec une première en utilisant OpenCL et une seconde fois en utilisant Metal. Dans les deux cas, le test a été fait en utilisant la carte interne nVidia GX 780M, puis l’AMD Radeon VII.

Avec OpenGL, le rapport est supérieur à 11, alors qu’avec Metal, ce rapport n’est que de 3,5. Plusieurs raisons peuvent expliquer cela :

- Les drivers Metal ne sont pas encore optimisés pour la Radeon VII

- La version de Catalina utilisée n’est qu’en version

Beta 2Beta 3 (upgrade lors de la rédaction de ce billet) - Le ThunderBolt 1 peut, en effet, limiter la carte.

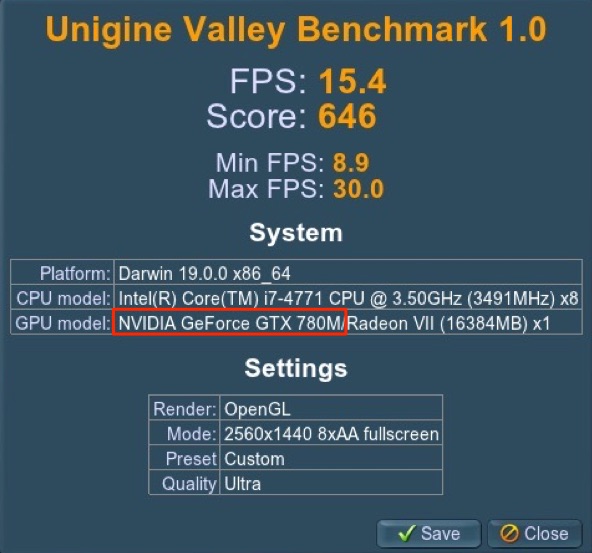

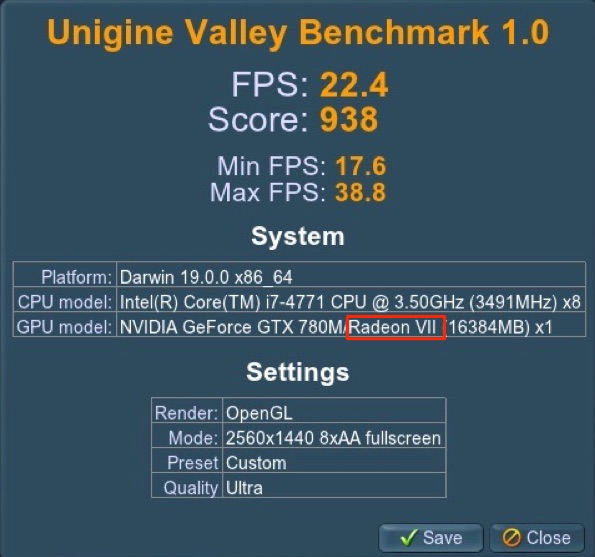

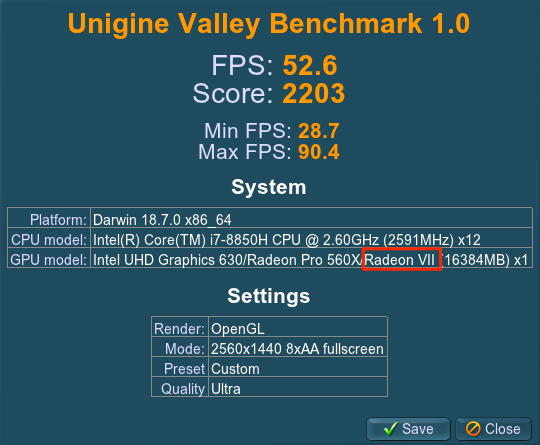

Unigine Valley

Avec toutes les options activées (rendu OpenGL) :

- Fullscreen : 2560×1440

- Qualité : Ultra

- AntiAliasing : 8X

Le rapport est « seulement » de 1.5, ce qui peut paraitre étonnant de prime abord.

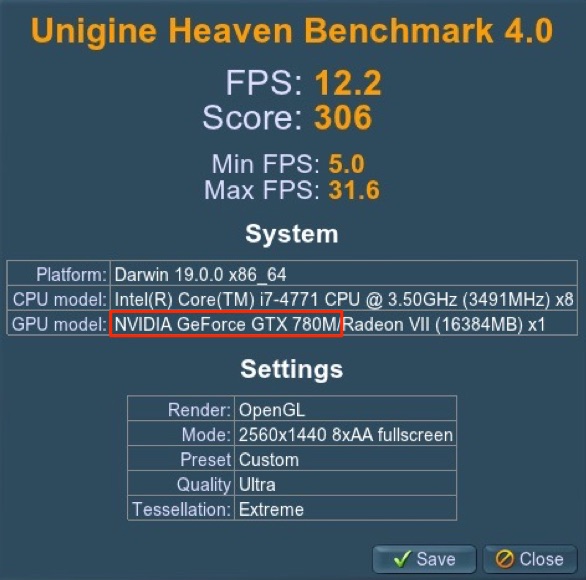

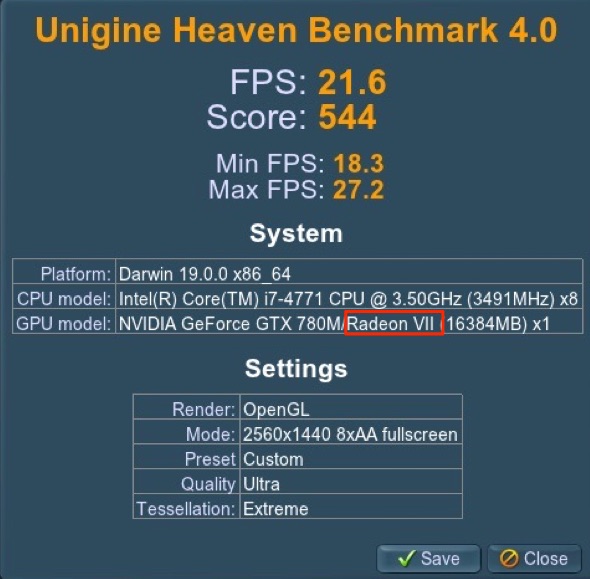

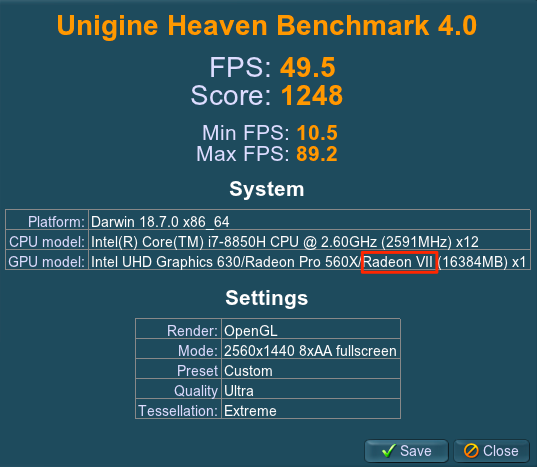

Unigine Heaven

Avec toutes les options activées (rendu OpenGL) :

- Fullscreen : 2560×1440

- Qualité : Ultra

- AntiAliasing : 8X

- Tessellation : Extreme

Dans cette nouvelle version, encore plus exigeante, l’écart passe cette fois-ci à près de 1.8, mais alors que la GFX 780M chute de 20% la Radeon VII ne perd que 4%. Est-ce le ThunderBolt 1 le facteur limitant ou bien ce sont les drivers qui ne sont pas optimisés ?

Et en Thunderbolt 3 ?

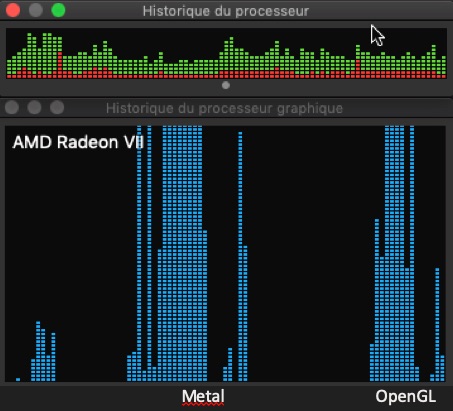

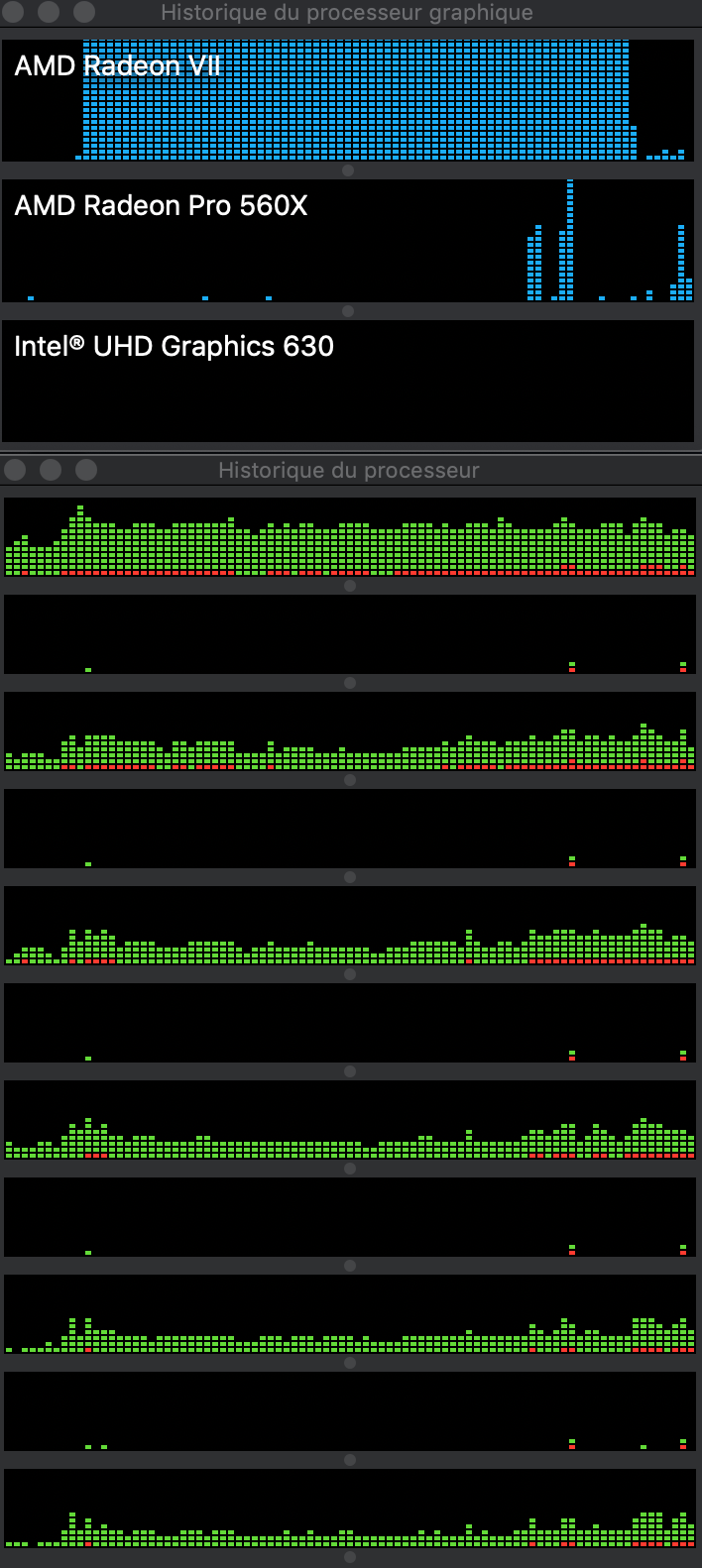

La réponse est apparue tout naturellement avec le même Bench réalisé sur mon MacBook Pro 15″ (mid-2018), équipé d’un processeur 6-core Intel Core i7, Turbo Boost up to 4.3GHz, with 9MB shared L3 cache. Le processeur est plus puissant que l’i7 4-core de l’iMac mais, comme le montre le graphe suivant, le processeur n’est pas un facteur déterminant lors des tests (la charge processeur restant stable dans le temps), que ce soit avec OpenCL, OpenGL ou Metal :

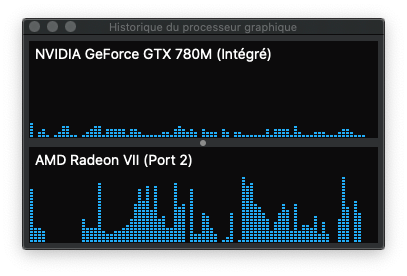

Ceci est également confirmé par le graphe suivant, qui montre clairement que le processeur n’est pas sollicité plus que d’ordinaire lorsque le BenchMark Heaven est lancé sur l’iMac; par contre, chose intéressante, on voit également que la carte nVidia intégrée ne se tourne pas les pouces afin de gérer ce qu’elle a a gérer lorsque l’eGPU est sollicité à 100%.

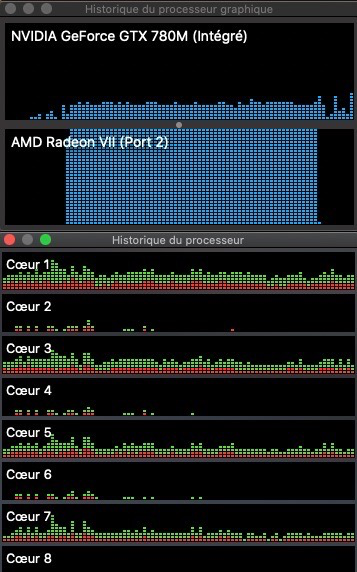

Même constat sur le MacBook Pro lors des Benchmark Valley (gauche) ou Heaven (droite), alors que ce dernier sollicite beaucoup plus la carte graphique. Dans les deux cas la charge processeur n’est pas impactée (ce qui est logique au demeurant pour une bench graphique). Cela va donc permettre de comparer réellement l’impact du TB 1 par rapport au TB 3.

Premier constat, lorsque l’eGPU est rattaché directement à un port Thunderbolt 3 et non Thunderbolt 1 les résultats des benchs Valley et Heaven montrent davantage le potentiel de la Radeon VII (et, au passage l’impact de l’option Tesselation sur les performances ) :

Que ce soit pour Valley ou Heaven, on observe en effet un rapport de performance de 2.3 par rapport aux tests réalisé sur l’iMac, ce qui montre que, dans ma configuration, le TB 1 est bien un facteur limitant, même si l’amélioration des performances graphiques est réelle.

Ce constat doit être relativisé avec le fait que mon écran secondaire étant connecté non pas sur l’eGPU (comme préconisé par Apple) mais sur un Display Port d’un périphérique connecté au second port TB 1 de l’iMac, cela tend à impacter les performances comme l’explique Apple. Conclusion : si vous avez la possibilité de rattacher votre écran secondaire à l’eGPU sans obtenir un écran noir sur celui-ci, alors les performances en TB 1 seront meilleures.

Y aller ou pas ?

C’est bien gentil tous ces benchs me direz vous, mais concrètement ça donne quoi ? Et vous aurez raison ! Un bench, c’est bien, mais cela n’indique que des perfs dans un contexte particulier dont l’objectif est de pousser la matériel dans ses retranchements. Or, il convient d’estimer l’apport réel pour votre utilisation afin de savoir si le jeu en vaut la chandelle.

A la question « le ThunderBolt 3 est-il obligatoire pour utiliser un eGPU ? », la réponse est clairement « Non » et c’est franchement une bonne chose car même si pour le moment votre machine ne dispose pas encore de TB 3, ça peut justifier l’investissement dès maintenant. D’autre part, le fait de rajouter un ou plusieurs eGPU à une configuration récente (du mac Mini à l’iMac Pro en passant par l’iMac et le MacBook Pro) montre que cette puissance de calcul supplémentaire peut être exploitée en sus du GPU intégré dès lors que l’eGPU est reconnu par l’OS. Tout se joue pour le moment au niveau des applications. Il y a cependant de l’espoir à ce niveau car d’ors et déjà c’est tout à fait possible (cf. la gestion parfaite avec DaVinci Resolve qui est gratuit) dès lors que l’éditeur s’en donne la peine … (allo Adobe ? Vous m’entendez ? 😉 ). Nous en sommes au début de la démocratisation du eGPU et le meilleur reste encore à venir, mais si vous décidez de faire le pas alors je vous conseille de partir sur une solution évolutive, dans laquelle :

- Vous pourrez changer de carte graphique, car avant de saturer la bande passante du TB 3, il va se passer un peu de temps ! Donc un boitier externe TB 3 actuel devrait tenir le choc pendant quelques années. Et même si vous n’êtes pas encore en TB 3, l’améliorations des performances graphiques est tout de même au rendez-vous;

- La puissance de l’alimentation du boitier TB 3 externe permette d’encaisser les quelques 300W que peut consommer une carte graphique moderne qui tourne à plein régime (une alimentation de 650W est donc recommandée). A ce propos, j’avais entendu parler de problème de bruit des 3 ventilateurs de la Radeon VII qui a tendance à chauffer : rien de tout cela dans mon installation, le boitier Sonnet est bien ventilé, discret et les drivers MacOS gèrent parfaitement les ventilateurs de la carte. On les entend juste progressivement monter en volume lorsque la carte est fortement sollicitée (benchmarck ou jeu video type Unreal Tournament avec toutes les options au max) mais rien d’insupportable.

A la question « est-ce que ça vaut le coup ? », la réponse est « ça dépend » :

- Si vous ne faites que de la bureautique et de l’internet, ça n’aura évidemment aucun effet (même si je vois que Firefox exploite le eGPU, la différence n’est pas vraiment visible); vous pouvez passer votre chemin (mais je doute alors que vous m’ayez lu jusqu’ici 😉 )

- Si vous utilisez un logiciel de post-traitement photo, du type Adobe Lightroom ou ON1 Photo Raw 2020, cela peut apporter un certain confort supplémentaire, en fonction de votre config actuelle :

- Si elle est récente, on peut différencier deux cas :

- Si vous disposez d’une carte graphique déjà performante (comme sur un iMac 27″ 2019 ou un iMac Pro où il est nécessaire de pouvoir gérer correctement l’écran 4K ou 5K) alors le gain peut ne pas être substantiel (pour le moment) pour justifier l’investissement immédiat; ce sera du cas par cas, application par application. Dans le cas de Lightroom 8.4.1 par exemple, cela n’a aucun intérêt sauf à mettre une carte haut de gamme clairement plus performance sur un écran secondaire, ce dernier ne sachant pas gérer deux cartes graphiques (donc un GPU et un eGPU) pour le moment (attention encore une fois, si vous partez sur nVidia et si vous êtes sous MacOS il vous faudra alors être sous High Sierra; sinon sous Windows aucun problème). Néanmoins l’utilisation du GPU par les logiciels se démocratisant, il y a de fortes chances à mon avis pour que les applications de post-traitement photo sachent un jour gérer deux cartes graphiques. A partir de là ça deviendra intéressant; la balle est clairement dans le camp des éditeurs.

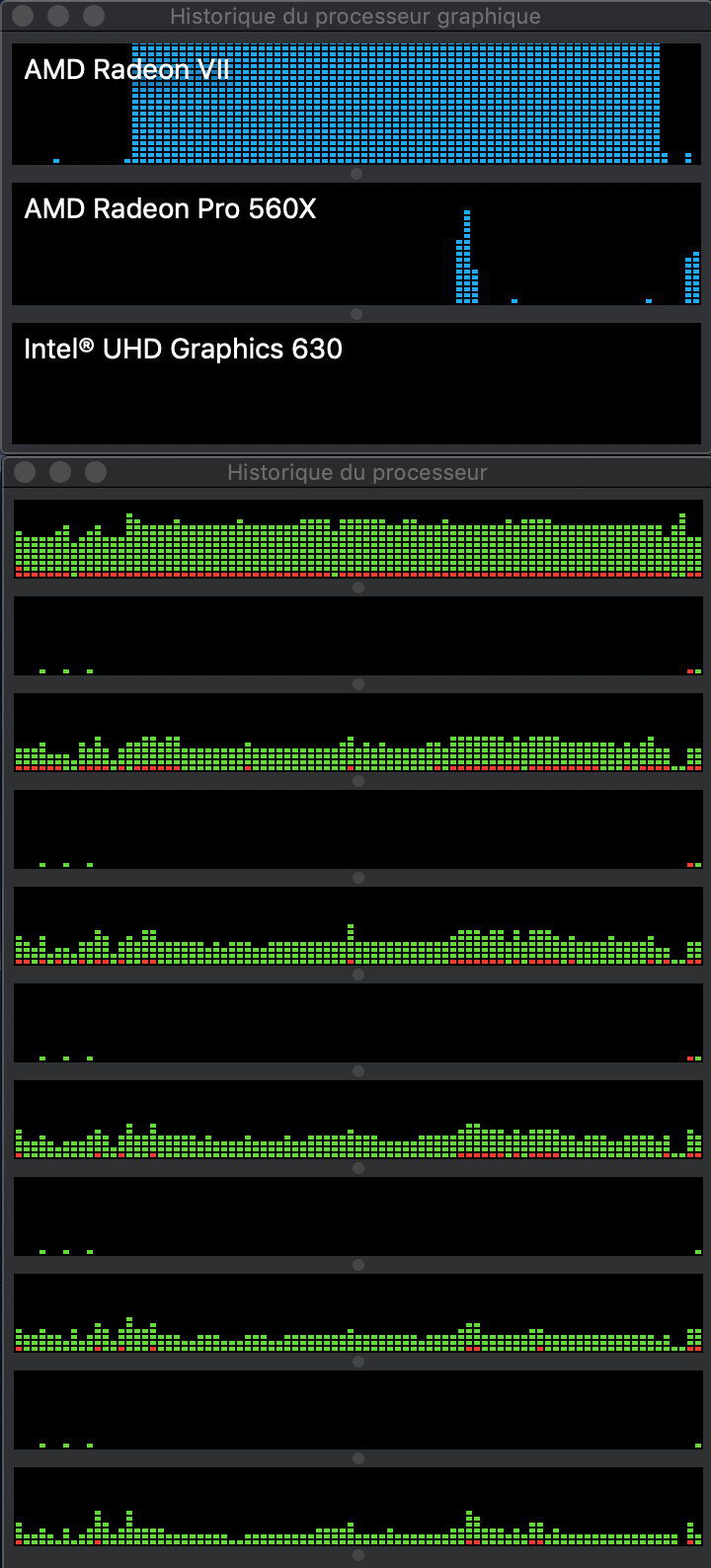

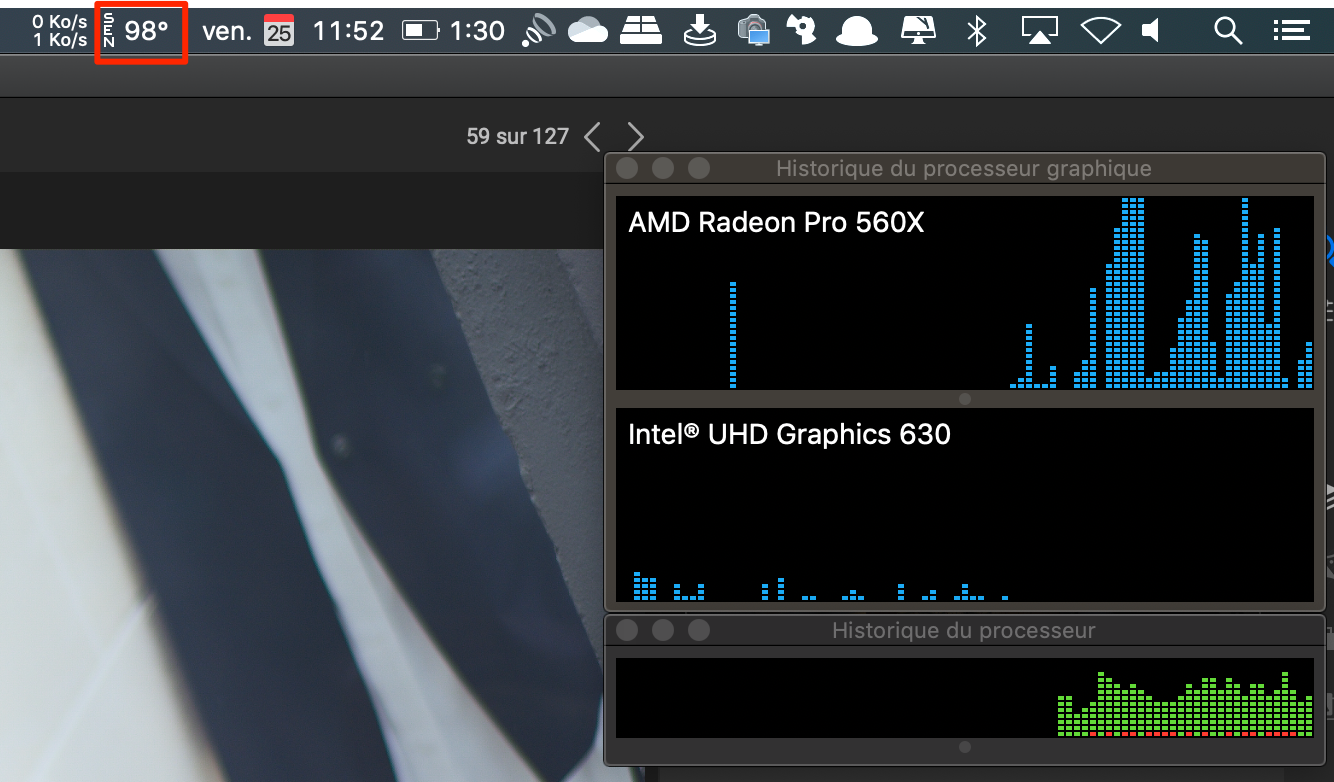

- Si vous disposez d’un MacBook Pro 2018 ou 2019, bien qu’ils renferment une carte graphique correcte (pour ma part une Radeon Pro 560X 4Go dans mon MacBook Pro late-2018 – i7 hexa-coeurs, 32 Go de RAM que j’utilise un peu pour la photo mais surtout pour faire tourner une VM Windows Server 2016 pour mon activité professionnelle principale), le processeur reste fortement sollicité avec Lightroom 8.4.1 ou ON1 Raw Photo 2020 (graphe de gauche ci-dessous). Il monte jusqu’à 100°C avant que les ventilateurs ne se mettent en marche, ce qui fait que ces derniers se font rapidement entendre au point d’en devenir gênant. Et bien, lors du test du eGPU rattaché directement en TB 3 (graphe de droite ci-dessous), le processeur est plutôt restés dans les 70°C-75°C (malgré des pointes très très courtes à 100°C) ce qui fait que les ventilateurs n’ont pas eu à tourner exagérément vite, avec un confort sonore appréciable à la clé. De même que pour un iMac de dernière génération si vous choisissez une carte graphique haut de gamme clairement plus performance que celle qui est intégrée et que vous disposez déjà d’un écran externe, là aussi l’amélioration peut être perceptible mais ça ne devrait rester que dans le domaine du confort pour le moment (n’attendez pas un fonctionnement 2x plus rapide par exemple).

Montée en température du processeur i7 du MBP 15″ late-2018 sous Lightroom 8.7.1 sans eGPU (à gauche) et avec eGPU (à droite)

- Si elle est moins récente, comme par exemple mon iMac late-2013 ou, mieux, une machine disposant d’un port TB 3 mais sans GPU dédié (comme sur le Mac Mini 2018), et bien les améliorations seront à minima notables, voire importantes, même si elles restent dépendantes du nombre de fonctions du logiciel qui utilisent le GPU/eGPU. Je pense que ça va aller crescendo avec les prochaines mises à jour ou versions de ces logiciels, tant les performances sont un sujet récurrent lorsque l’ont doit gérer un flux de données important (au hasard, les 2000 photos d’un mariage). Ca me fait penser un peu à l’apport du SSD sur une machine qui commençait à donner des signes de fatigue : ça faisait sauter le goulot d’étrangement et la machine semblait alors « reprendre vie ». Je pense donc, pour ma part, que les éditeurs vont baser de plus en plus les calculs réalisés sur des fonctions qui seront dédiées au GPU (et donc au eGPU). L’année 2020 sera intéressante à ce sujet, et je mettrai prochainement à jour mon comparatif en y ajoutant ce critère, car pour le moment toutes les solutions n’exploitent pas le GPU (j’espère notamment que Luminar 4 n’aura pas loupé le coche , car ce n’est pas le cas avec la version 3 : réponse le 18 novembre, lors de la sortie officielle).

- Si elle est récente, on peut différencier deux cas :

- Si vous utilisez un logiciel de montage vidéo ou de modélisation 3D, l’intérêt de s’appuyer sur un GPU / eGPU ne se pose même plus sur le papier. Par contre, le fait de rajouter un eGPU à votre config dépend surtout de votre configuration et de votre utilisation (amateur/pro mais dans le 2 cas j’imagine que vous disposez déjà d’un bête de course); c’est donc la solution logicielle que vous utilisez qui fera ou non que la puissance de GPU / eGPU soit exploitée, certaines d’entres elles sachant même exploiter les deux à la fois (par exemple, DaVinci Resolve est un modèle du genre) ! Si tel est le cas, l’ajout d’un eGPU pourra vous apporter un gain réel en performance.

- Si vous êtes un Gamer (que faites vous sur Mac ??? 🙂 ), et bien sachez que les améliorations sont bien réelles. En tant qu’ancien Gamer j’ai installé pour l’occasion Unreal Tournament (gratuit), Fortnite (gratuit), FlightGear (gratuit), Counter-Strike (Gratuit) et j’ai même acheté Xplane 11. En fonction du jeu (et de son support d’OpenGL/OpenCL et/ou de Metal), les gains sont différents mais on peut enfin jouer confortablement sur un Mac même s’il ne sera jamais un machine de Pure Gamer, le marché n’étant pas assez juteux pour les éditeurs (l’offre est donc limitée en termes de titres). Par contre, l’utilisation de Boot Camp afin de lancer alternativement Windows sur le même Mac est une possibilité à envisager si vous voulez jouer sérieusement. Encore une fois, le site eGPU.io (en anglais) est votre ami pour tenter de faire fonctionner Boot Camp avec un eGPU.

Et enfin, à la question « est-ce intéressant vu le prix ? » , là encore la réponse est « ça dépend » …

- Si vous partez sur une configuration non évolutive, ça risque de diminuer la pérennité de l’achat car d’ici les 2 à 3 années à venir car les cartes intégrées dans les eGPU « Out of the Box » (type Black Magic) seront probablement dépassées par celles directement intégrées dans les ordinateurs à venir.

- Si vous partez sur une solution évolutive il y a de fortes chances que votre boitier d’extension tienne la route plusieurs années (j’estime entre 8 à 10 ans, voire davantage) vu la bande passante maximale théorique offerte par le Thunderbolt 3. Et si votre carte graphique au format PCI Express (PCIe) s’essouffle avec le temps, il vous suffira juste de la changer par une plus véloce. Sauf révolution dans ce domaine, je n’ai pas connaissance d’un nouveau standard émergeant dans ce domaine, à savoir que les futures cartes graphiques devraient demeurer au format PCIe. Certes, la norme PCIe 3.0 (largement répandue actuellement) sera d’ici là peut-être passée concrètement en 4.0 voire 5.0 (les specs sont prêtes) mais quand on sait qu’actuellement le bus PCIe 3.0 16x (16 Go/s de bande passante) n’est pas encore saturé, il y a de la marge ! De plus le rétro-compatibilité devrait être assurée. Bref, vous pourrez changer votre carte graphique dans votre boiter externe.

En résumé

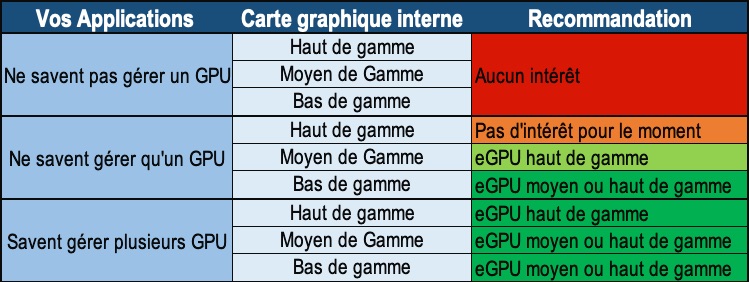

J’en conviens aisément, il n’est pas aisé de prime abord de s’y retrouver. Pour vous aider à creuser la question pour votre propre besoin (car à chaque configuration sa solution), je vous propose les deux tableaux suivants :

- Le 1er résume les éléments essentiels à retenir évoqués dans ce billet

- Le 2nd est une aide au choix simplifiée, sur le fait d’acquérir ou non un eGPU, en fonction des applications que vous souhaitez accélérer

Pour ma part, on va dire qu’avec un iMac 27″ late-2013 sous Catalina et mon nouveau eGPU à base d’une carte graphique haute de gamme je peux encore patienter avant de passer à l’iMac Pro (les iMac 27″ 2019 sont des machines poussées au maximum, qui chauffent et donc qui ventilent bruyamment dès lors que la machine est sollicitée); je partirai alors certainement sur une version 2017 avec processeur avec Xeon 10 cœurs lorsque le prix sera « intéressant » sur le refurb Apple, c’est à dire juste avant sa prochaine mise à jour, sûrement en 2020). A ce moment-là, peut-être que les fonctions de post-traitement de Lightroom et de ses concurrents sauront encore mieux exploiter un GPU, voire le GPU interne ET l’eGPU (c’est, je le pense, le sens de l’histoire), et je pourrai alors bénéficier des performances maximales de mon eGPU. En attendant, je me « contente » des améliorations apportées à mes applications photos & vidéo, dans la limite de leurs possibilités actuelles qui vont augmenter progressivement, et je me même permets de pouvoir jouer un peu si le cœur m’en dit.

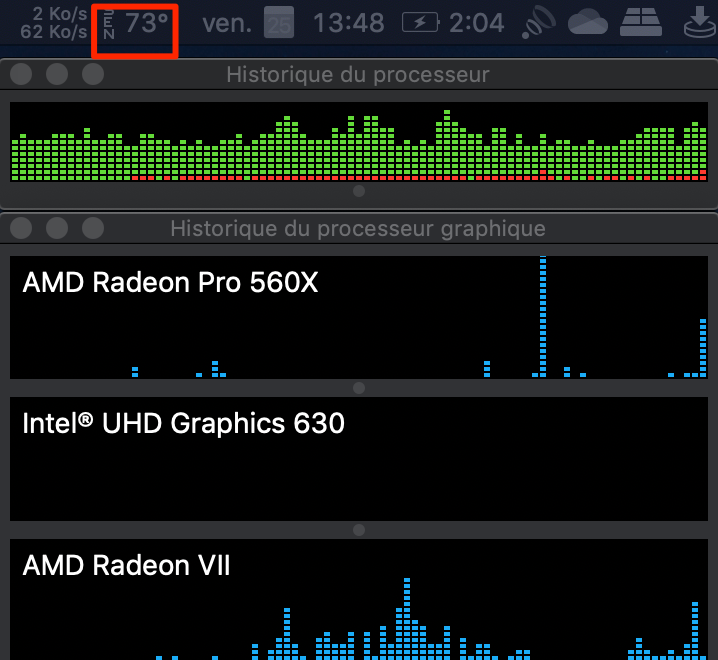

UPDATE du 4 Novembre 2019

La version 9.0 de Lightroom Classic qui est disponible depuis aujourd’hui continue d’améliorer la prise en compte du GPU/eGPU (dès lors que celui-ci est supporté) apportant une fluidité de plus en plus perceptible (évidemment sous réserve que l’ensemble CPU / RAM / Disque Dur tienne la route). En effet, depuis que la version 7.1 (datant de fin 2017) évoquée précédemment a introduit un début de prise en compte du GPU/eGPU, l’usage des brosses locales et des filtres radiaux, la suppression des défauts ou l’affichage des effets au niveau du crop sont des fonctions qui supportent désormais le GPU, comme le montre l’utilisation plus marquée de l’eGPU sur le graphe ci-dessous, après quelques manipulations utilisant ces fonctions. Pourvu qu’Adobe ne s’arrête pas en si bon chemin !

Point important que je n’avais pas précisé auparavant, il faut impérativement utiliser la version 5 du process de dématricage de Camera RAW pour bénéficier de l’accélération du GPU/eGPU. Autre évolution notable, Lightroom 3.0 (la version Cloud de Lr sortie également ce jour), supporte désormais le GPU/eGPU.

Côté jeu, j’ai profité d’une promo avec 80% de remise qui fait que j’ai pu acquérir également F1 2017, Dirt 4, Grid Autosport, Mad Max, Rise of the Tomb Raider et Hitman pour une soixantainte d’euros au total ! Visuellement, c’est du grand bonheur et c’est vraiment fluide (F1 2017 en 1600×900 avec toutes les options à fond m’assure entre 41 (forte pluie) et 60 (temps sec) img/s en course (avec 20 concurrents) sur mon iMac en TB 1, ce dernier plafonnant à 42% de charge).

Point intéressant à noter, le plafonnement à 60 img/s semble lié à config en TB 1, ce qui veut dire que sur une configuration en TB 3, la carte pourra se « lâcher » et fournir un frame rate bien supérieur. A suivre …

Bonjour,

Merci pour cet article.

Je suis l’heureuse détentrice d’un iMac fin 2013, osCatalina 10.15.7, i7 3,5GHz, 32 go de Ram et cette bonne vielle NVIDIA GeForce GTX 775M 2Go. J’ai aussi une tablette Wacom cintiq 22’’.

Je suis actuellement en train de regarder l’intérêt d’un eGPU car je perçois les limites de performances. Photoshop tourne bien mais le logiciel 3D DAZ peine à suivre le rythme.

Me voilà donc plongée dans toutes ces informations et j’avoue me perdre.

Nous sommes en 2021, le temps est passé depuis votre article. Avez vous plus de recul et un avis toujours positif sur cet investissement ? De nouveaux conseils ? Merci encore

Bonjour Sylvie,

Merci pour votre message. Votre question me parait tout à fait pertinente.

Dans votre cas, votre iMac fin 2013 ne possède que des ports ThunderBolt 1/2 et donc cela nécessite absolument de patcher l’OS avec le script « purge-wrangler.sh » (cf. lien dans l’article). Ce n’est pas très compliqué si vous avez quelques compétences d’administrateur système sous MacOS, sinon passez votre chemin mais ce serait dommage car le gain n’est pas négligeable et il le sera plus encore si vous passez à un Mac Intel avec des ports Thunderbolt 3 (TB3). ATTENTION cependant, il semble que les nouveaux Mac M1 (processeur d’Apple) ne suportent pas encore les eGPU même si certains signes semblent encourageants (cf. https://www.soydemac.com/fr/la-no-compatibilidad-de-apple-silicon-con-las-egpu-puede-ser-temporal/)

Pour ma part, près de 2 ans après la mise à jour de l’article j’ai toujours le même boitier eGPU et la même carte AMD Radeon VII. Par contre je suis passé à l’iMac Pro (Proc. Xeon 10 Core) disposant de ports TB3 et ça fonctionne parfaitement sous Big Sur (11.6). Les perfs graphiques sont similaires à celle de mon MacBook Pro 15″ du test. Par contre le support des eGPU a bien progressé en deux ans : Lightroom Classic, Silver FX Pro, Topaz Sharpen AI et Da Vinci Resolve exploitent désormais pleinement les performances de l’eGPU, ce dernier étant même chargé à 100% pour les gros calculs.

En synthèse, je suis toujours satisfait de mon achat. Pour autant attention à bien choisir une boitier et une carte vidéo offciellement supportés par l’OS pour éviter toute surprise désagréable.

Bonjour,

J’ai aussi un iMac 2013 / geforce 775m et comme vous savez sûrement la nouvelle version d’adobe demande de passer à big sur. J’ai donc patcher la machine et installé big sur mais la plus de mercury engine / metal sous premiere … je me demande si avec un egpu et une Radeon ça marcherait ? Help !

Désolé pour le détail interminable de ma réponse. Si Première sait tirer partie du GPU alors oui le eGPU et une carte graphique seront supportés (dès lors que le système les détecte). Pour info je vends mon ePGU et ma Radeon VII (je suis passé sur un Mac Studio Ultra donc plus besoin)